多层神经网络算法的工作原理

相关报告

- 数据更新中...

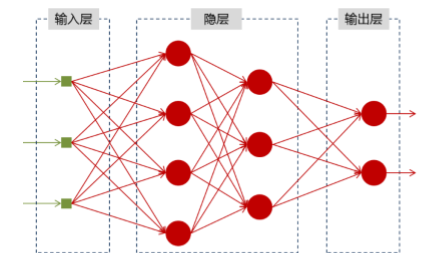

一般而言,在输入层和输出层之间包含至少1个隐层即可称之为多层。下图是一个双隐层神经网络结构示意图。其中输入层神经元仅接受外界输入信号,不进行函数处理,隐层和输出层神经元为功能神经元,对信号进行加工处理,最终结果由输出层神经元输出。

双隐层神经网络结构示意图

多层神经网络的学习过程同样是根据样本训练数据来对神经元之间的连接“权值”以及每个神经元的决策阈值进行调整,多层神经网络结构中的单个“神经元”工作机制与单层感知机非常相似。

多层神经网络的训练借助了“误差反向传播算法”。多层神经网络的训练通过将最后一层输出结果与实际结果之间的误差分配给前一个层,如果存在不止一个隐层,则在刚才分配的基础上将误差继

续向靠近输入端的隐层分配。这样神经网络中每一个参数的调整都会带来整体误差的变化,通过优

化技巧找出最小化误差,从而完成多层神经网络的训练,这也正是在神经网络算法发展史上有着里程碑式作用的“误差反向传播算法”。

本文地址:http://www.zwzyzx.com/show-269-224853-1.html

上一篇:感知机,神经网络开始的地方

下一篇:神经网络发展几经波折

相关资讯

- 中国节水灌溉行业的发展历史(2016-01-26)

- 虚拟/3D交互显示,“拓”视野“通”向未来(2016-06-20)

- 电子测量仪器制造商在中国市场的销售规模(2014-08-21)

- 银行业渠道类解决方案(2015-12-17)

- 中国PCB行业下游应用领域分布情况(2015-08-06)

- 光城市建设带动光缆的需求增速保持高位(2016-11-09)

- 电极箔相关情况简介(2015-01-04)

- 英迈国际四大业务条线平行运营(2016-10-25)

合作媒体

最新报告

定制出版

热门报告

免责声明

中为咨询所引述的资料是用于行业市场研究以及讨论和交流,并注明出处,部分内容是由相关机构提供。若有异议请及时联系本公司,我们将立即依据相关法律对文章进行删除或作相应处理。查看详细》》